Analisi di regressione (cap. 15)

1/4

There's no tags or description

Looks like no tags are added yet.

Name | Mastery | Learn | Test | Matching | Spaced | Call with Kai |

|---|

No analytics yet

Send a link to your students to track their progress

5 Terms

regressione lineare semplice

regressione lineare multipla

regressione lineare multivariata

Regressione lineare semplice

Una variabile indipendente (X) predice una variabile dipendente (Y)

Y = a + bX

Esempio: ore di studio (X) → voto esame (Y)

Regressione lineare multipla

Più variabili indipendenti (X₁, X₂, …) predicono una variabile dipendente (Y)

Y = a + b₁X₁ + b₂X₂ + … + bkXk

Esempio: ore di studio + qualità del sonno → voto esame

Regressione multivariata

Più variabili indipendenti predicono più variabili dipendenti contemporaneamente

Y₁, Y₂, …, Ym = a + bX₁ + cX₂ …

Esempio: ore di studio + qualità del sonno → voto esame e livello di ansia

Errore di predizione

È la differenza tra il valore osservato (Y) e il valore predetto dalla retta di regressione (Ŷ)

Formula: Errore (e) = Y – Ŷ

Tipi di deviazione: spiegata, non spiegata e totale

Totale = Spiegata + Non spiegata

Dev spiegata: Parte della variabilità di Y spiegata dal modello (cioè dalla retta di regressione)

Dev non spiegata: Parte della variabilità di Y non spiegata dal modello

Dev totale: Scostamento dei valori osservati dalla media di Y

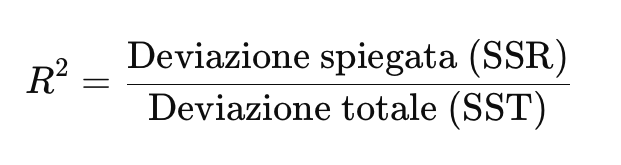

Coefficiente di determinazione (R²)

Indice che misura quanta parte della variabilità totale di Y è spiegata dal modello di regressione (cioè da X)

“quanto bene la retta di regressione si adatta ai dati”

indicatore della forza predittiva del modello

Valori possibili: da 0 a 1

0 → il modello non spiega nulla della variabilità di Y

1 → il modello spiega tutta la variabilità di Y

→ nel caso della regressione lineare semplice è il coefficiente di Pearson alla seconda (R*2 = r*2)

cosa sono a e b nell'equazione di regressione?

a = intercetta (costante)

È il valore di Y quando X = 0.

Graficamente: il punto in cui la retta taglia l’asse Y.

b = coefficiente angolare (pendenza)

Indica di quanto varia Y se X aumenta di 1 unità.

Segno di b:

positivo → relazione crescente

negativo → relazione decrescente