pres 2 eembedings

1/7

There's no tags or description

Looks like no tags are added yet.

Name | Mastery | Learn | Test | Matching | Spaced | Call with Kai |

|---|

No analytics yet

Send a link to your students to track their progress

8 Terms

embeddings

vectores densos utilizados para representar texto. Sus dimensiones son fijas y no dependen del tamaño del vocabulario.

diferencia con bag of words y tf-idf

capturan el significado semántico de palabras o frases

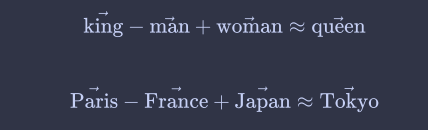

Los embeddings capturan relaciones semánticas como direcciones en el espacio vectorial:

Estas relaciones emergen del entrenamiento sin ser programadas explícitamente. El modelo aprende que la "dirección" de género o de capital-país es consistente en el espacio.

Word2Vec

primeros modelos exitosos para aprender embeddings de palabras. Aprende vectores de palabras a partir de grandes corpus de text

continous bag of words

Esta variante de Word2Vec predice la palabra central dado su contexto. Es decir, el modelo recibe las palabras que rodean una palabra central desconocida y predice el vector para esta palabra.

skip=gram

Esta variante predice las palabras de contexto dada la palabra central. El modelo recibe una palabra y predice las palabras que más probablemente la rodeen en el texto.

Word2Vec con Gensin

model = Word2Vec(sentences, vector_size=100, window=5, min_count=1, sg=1) vector = model.wv["cat"]